Inicio /

Insights /

Por Qué Tu Empresa Necesita Ingenieros Reales en la Era de la IAWhy Your Company Needs Real Engineers in the AI Era

IADesarrollo SeguroIngenieríaOpiniónSeguridadArquitecturaEmpresaProducción

Por Qué Tu Empresa Necesita Ingenieros Reales en la Era de la IA

Why Your Company Needs Real Engineers in the AI Era

6 de abril de 2026

4 min

DCM System

IA Sin Ingenieros: Error

Usar IA sin revisión humana no ahorra costos — abre puertas que cualquier atacante puede cruzar.

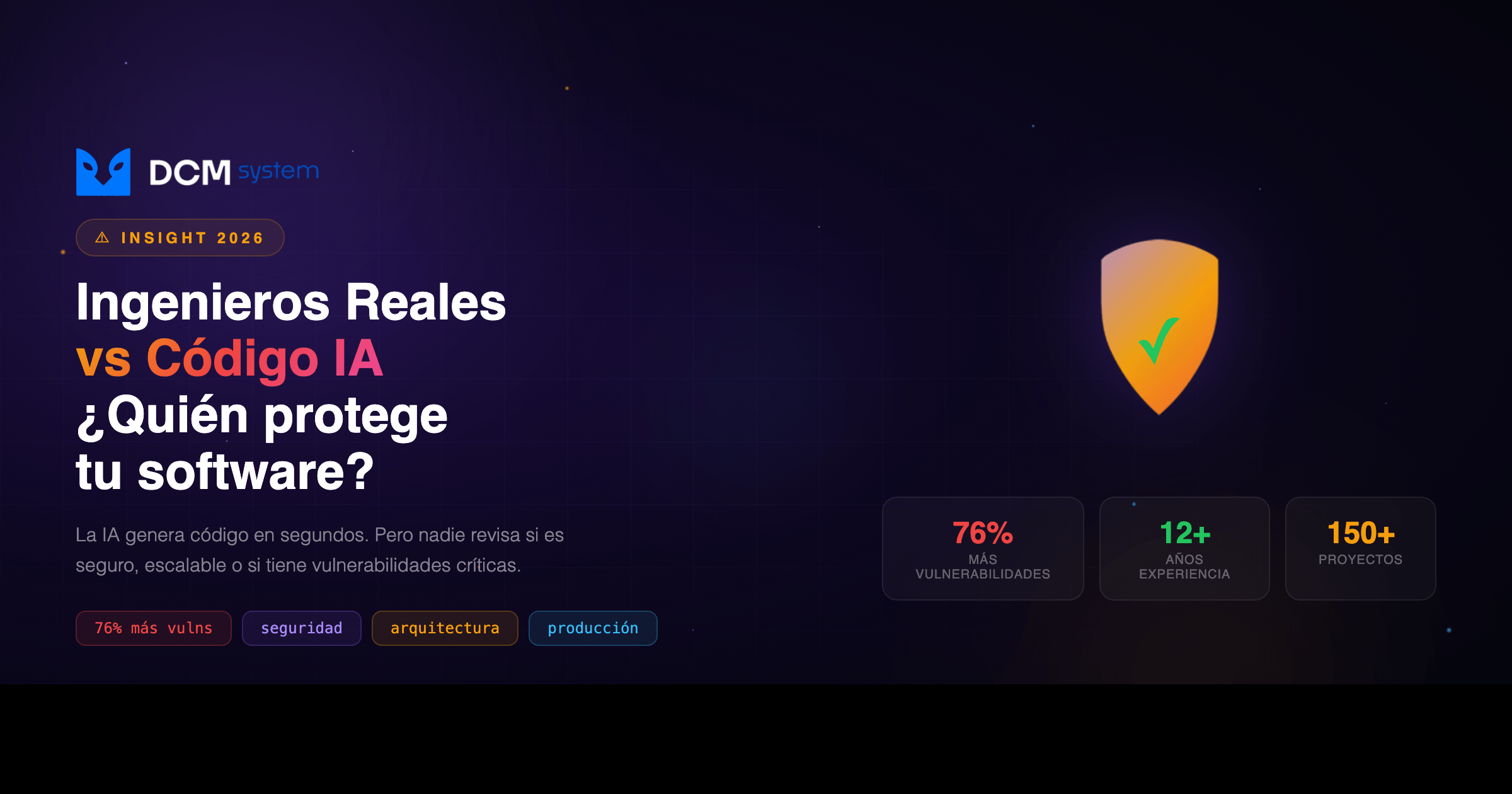

[DATO REAL]: Un estudio de Stanford (2023) encontró que los desarrolladores que usaron asistentes de IA produjeron código con un 76% más de vulnerabilidades de seguridad que quienes escribieron el código a mano — y se sentían más seguros sobre la calidad de su trabajo. Fuente: arxiv.org/abs/2211.03622

En este artículo vas a:

- Entender exactamente qué puede y qué no puede hacer la IA en desarrollo de software

- Ver las 4 preguntas que toda empresa debería hacerle a su proveedor de software antes de contratar

- Saber cómo usar IA como multiplicador de fuerza sin sacrificar seguridad

- Evaluar si tu operación actual tiene el nivel de supervisión humana que necesita

01 EL PROBLEMA REAL

El código generado por IA compila. Pasa los tests básicos. Funciona. Ese es exactamente el problema.

“Funciona” y “está listo para producción” son dos cosas completamente diferentes. Y la brecha entre esas dos cosas — vulnerabilidades sin parchear, secretos hardcodeados, falta de rate limiting, cifrado incompleto — es por donde entran los atacantes.

Un atacante no necesita que todo tu código sea vulnerable. Necesita una sola puerta abierta. El código generado automáticamente está lleno de puertas que nadie revisó.

PIÉNSALO ASÍ

Es como decir que tu carro enciende. Bien. Pero, ¿tiene frenos? ¿Tiene airbags? ¿Aguanta un choque a 120 km/h? El código generado por IA enciende. Lo que no tiene son frenos.

| Sin revisión humana |

El costo |

Con ingenieros reales |

| Código que “funciona” en dev |

Breach, pérdida de datos, multas SIC |

Código que aguanta producción real |

02 POR QUÉ PASA

Los LLMs predicen el siguiente token. No modelan amenazas, no conocen tu infraestructura, no saben qué cambia tu proveedor de pagos sin aviso.

El código que genera un modelo de lenguaje refleja los patrones estadísticos de su entrenamiento — incluyendo los malos. Si la mayoría de los ejemplos de StackOverflow que vio no implementaban rate limiting, el modelo tampoco lo va a implementar. Si los ejemplos de autenticación en su dataset tenían secrets hardcodeados, el modelo va a reproducir ese patrón.

El resultado es código que se ve limpio, pasa linters y hasta tiene tests unitarios en verde — pero con huecos de seguridad que ninguna herramienta automática detecta sin contexto de negocio.

Y el fenómeno es peor de lo que parece: los desarrolladores que usan IA reportan sentirse más confiados en la calidad de su código. Es el equivalente digital de cerrar la puerta con llave y dejar todas las ventanas abiertas.

03 LA SOLUCIÓN

La IA es la herramienta más poderosa que ha llegado al desarrollo de software en décadas. El problema no es usarla — el problema es usarla sin supervisión humana.

Lo que la IA sí hace bien:

- Acelerar prototipado — lo que tomaba una semana ahora toma horas

- Automatizar testing — detectar patrones que un humano tardaría días en encontrar

- Generar documentación desde el código, no desde la imaginación

- Identificar deuda técnica y sugerir mejoras de rendimiento

Lo que la IA no puede hacer:

Diseñar arquitectura que no se caiga. La diferencia entre “funciona en mi laptop” y “funciona con 10,000 usuarios simultáneos sin perder datos” se llama arquitectura. Y la arquitectura no se aprende con prompts — se aprende con años de ver cosas explotar en producción. Bases de datos bajo carga, colas de mensajes saturadas, cachés que se invalidan, firewalls con reglas específicas: eso lo diseña un ingeniero senior, no un modelo.

Auditar su propio output. Preguntale al LLM si valida inputs contra inyección SQL — te va a decir que sí. Revisá el código — probablemente no de forma consistente. La IA no tiene criterio para evaluar lo que genera. Un ingeniero sí.

Responder a las 3AM. Cuando tu sistema de facturación se muere y estás perdiendo $50,000 por hora, no le mandás un prompt a ChatGPT. Llamás a un ingeniero que conoce tu infraestructura, tu base de datos, tus integraciones y los secretos sucios de tu código legacy. La IA no tiene oncall. La IA no tiene contexto de negocio.

Proteger la soberanía de tus datos. Cada vez que tu código pasa por una API de IA en la nube, tus datos pasan por servidores que no controlás. ¿Dónde quedan? ¿Quién tiene acceso? ¿Cumple con la Ley 1581? Esas preguntas se responden con infraestructura propia, cifrado end-to-end y un equipo que implementa auditoría y trazabilidad real.

El modelo correcto: la IA como multiplicador de fuerza, los ingenieros como responsables. Cada línea que genera la IA pasa por revisión humana. Cada deployment tiene un ingeniero con nombre y apellido. Cada decisión de arquitectura la toma un profesional con contexto de negocio.

04 CÓMO IMPLEMENTARLO

- Auditá el proceso actual. ¿Alguien revisa el código que genera la IA antes de que llegue a producción? ¿Hay un proceso formal o es “si compila, sube”?

- Definí quién es responsable de seguridad. No el equipo en general — una persona específica con nombre, apellido y autoridad para frenar un deployment.

- Implementá code review con enfoque de seguridad. Cada PR debería tener al menos una revisión de alguien que entiende los vectores de ataque: inyección SQL, XSS, secrets hardcodeados, acceso sin autenticación.

- Integrá SAST y análisis de dependencias en el CI/CD. Automatizado en cada push. Si introducís una vulnerabilidad conocida, el pipeline para antes de que llegue a staging.

- Hacé threat modeling antes de codear. ¿Qué datos maneja el sistema? ¿Quién podría querer acceder? ¿Qué pasa si falla cada componente?

- Documentá y practicá el plan de respuesta. Un documento de 5–10 páginas: si pasa X, hacemos Y. Practicadlo al menos una vez al año.

05 ¿ES PARA TI?

Sí, si tu empresa:

- ✅ Está generando o comprando software que usa IA en alguna parte del proceso

- ✅ Maneja datos de clientes, pagos o información sensible en sus sistemas

- ✅ No tiene claro hoy quién revisa la seguridad del código que se despliega

No, si:

- ❌ Tenés un equipo de ingeniería interno maduro con procesos formales de revisión de seguridad ya funcionando

- ❌ Solo usás software de terceros empaquetado (SaaS) sin desarrollo propio

Preguntas frecuentes

¿El código generado por IA es más barato si no lo revisa nadie? A corto plazo parece que sí. A largo plazo, un breach cuesta entre 3x y 10x lo que habrías gastado en revisión. Sin contar las multas de la SIC (hasta 2,600 millones de pesos en 2026) si el breach expone datos personales.

¿Cómo sé si mi proveedor actual tiene revisión humana real? Hacele estas 4 preguntas: ¿Quién revisa la seguridad del código generado por IA? ¿Quién diseñó la infraestructura de despliegue? ¿Quién responde si algo falla a las 3AM un domingo? ¿Sabés exactamente dónde están tus datos y quién tiene acceso? Si cualquier respuesta es “no sé” o silencio incómodo — tenés un problema de seguridad, no de presupuesto.

¿DCM usa IA en el desarrollo? Sí, todos los días. Para prototipado, testing, documentación y refactorización. Pero cada línea que genera la IA pasa por revisión humana. Cada deployment tiene un ingeniero responsable. La IA es el multiplicador de fuerza; el cerebro detrás sigue siendo humano.

Acción inmediata: Buscá en tu repositorio actual estas cadenas: password =, secret =, api_key =. Si aparecen valores hardcodeados en el código (no en variables de entorno), ya encontraste tu primer hueco de seguridad — y tardaste menos de 5 minutos.

¿Quieres ayuda? → Hablá con DCM — llevamos 12+ años construyendo software que no se cae, no se hackea y no depende de prompts para funcionar.

AI Without Engineers: A Mistake

Using AI without human review does not save costs — it opens doors any attacker can walk through.

[REAL DATA]: A Stanford study (2023) found that developers using AI coding assistants produced code with 76% more security vulnerabilities than those writing code by hand — and they felt more confident about the quality of their work. Source: arxiv.org/abs/2211.03622

In this article you will:

- Understand exactly what AI can and cannot do in software development

- See the four questions every company should ask its software vendor before signing

- Learn how to use AI as a force multiplier without sacrificing security

- Evaluate whether your current operation has the level of human oversight it actually needs

01 THE REAL PROBLEM

AI-generated code compiles. It passes basic tests. It runs. That is precisely the problem.

“Runs” and “is ready for production” are two completely different things. And the gap between them — unpatched vulnerabilities, hardcoded secrets, missing rate limiting, incomplete encryption — is exactly where attackers walk in.

An attacker does not need all of your code to be vulnerable. They need one open door. Auto-generated code is full of doors that nobody reviewed.

THINK OF IT THIS WAY

It is like saying your car starts. Fine. But does it brake? Does it have airbags? Does it survive a 75-mph crash? AI-generated code starts. What it lacks are the brakes.

| Without human review |

The cost |

With real engineers |

| Code that “works” in dev |

Breach, data loss, regulatory fines |

Code that holds up under real production |

02 WHY IT HAPPENS

LLMs predict the next token. They do not model threats, do not understand your infrastructure, and do not know that your payment provider just changed an API without warning.

The code a language model produces reflects the statistical patterns of its training data — bad patterns included. If most of the StackOverflow examples it absorbed did not implement rate limiting, the model will not implement it either. If the authentication examples in its dataset had hardcoded secrets, the model will reproduce that pattern.

The result is code that looks clean, passes linters, and even has unit tests in green — but with security holes that no automated tool detects without business context.

And the phenomenon is worse than it appears: developers who use AI report feeling more confident in the quality of their code. It is the digital equivalent of locking the front door and leaving every window wide open.

03 THE SOLUTION

AI is the most powerful tool to arrive in software development in decades. The problem is not using it — the problem is using it without human supervision.

What AI does well:

- Accelerating prototyping — what used to take a week now takes hours

- Automating testing — catching patterns a human would spend days mapping out

- Generating documentation from code rather than from imagination

- Identifying technical debt and suggesting performance improvements

What AI cannot do:

Design architecture that does not collapse. The difference between “works on my laptop” and “works with 10,000 concurrent users without losing data” is called architecture. And architecture is not learned through prompts — it is learned through years of watching things blow up in production. Databases under load, saturated message queues, cache invalidation, firewalls with specific rules: that is what a senior engineer designs, not what a model generates.

Audit its own output. Ask the LLM whether it validated inputs against SQL injection — it will say yes. Read the code — it probably did not, at least not consistently. AI has no judgment to evaluate what it generates. An engineer does.

Respond at 3 a.m. When your billing system goes down and you are bleeding $50,000 an hour, you do not send a prompt to ChatGPT. You call an engineer who knows your infrastructure, your database, your integrations, and the dirty secrets of your legacy code. AI carries no pager. AI has no business context.

Protect the sovereignty of your data. Every time your code passes through a cloud AI API, your data passes through servers you do not control. Where does it sit? Who has access? Does it comply with Colombia’s Ley 1581? Those questions are answered with infrastructure you own, end-to-end encryption, and a team that implements real auditing and traceability.

The right model: AI as a force multiplier, engineers as the responsible parties. Every line AI generates passes through human review. Every deployment has an engineer with a name attached. Every architectural decision is made by a professional with business context.

04 HOW TO IMPLEMENT IT

- Audit the current process. Does someone review the code AI generates before it reaches production? Is there a formal process, or is it “if it compiles, ship it”?

- Define who is responsible for security. Not “the team in general” — one specific person, with a name and the authority to halt a deployment.

- Implement security-focused code review. Every PR should have at least one review by someone who understands attack vectors: SQL injection, XSS, hardcoded secrets, missing authentication.

- Integrate SAST and dependency analysis into CI/CD. Automated on every push. If a known vulnerability is introduced, the pipeline stops it before staging.

- Do threat modeling before coding. What data does the system handle? Who would want access? What happens if each component fails?

- Document and rehearse the response plan. A 5–10 page document: if X happens, we do Y. Rehearse it at least once a year.

05 IS THIS FOR YOU?

Yes, if your company:

- ✅ Is generating or buying software that uses AI somewhere in the process

- ✅ Handles customer data, payments, or sensitive information in its systems

- ✅ Cannot say today, with certainty, who reviews the security of code being deployed

No, if:

- ❌ You have a mature internal engineering team with formal security review processes already running

- ❌ You only use packaged third-party software (SaaS) without any in-house development

Frequently asked questions

Is AI-generated code cheaper if nobody reviews it?

In the short term, it appears so. In the long term, a breach costs between 3× and 10× what you would have spent on review — without counting regulatory fines (up to 2.6 billion COP under Colombia’s SIC enforcement in 2026) if the breach exposes personal data.

How do I know if my current vendor performs real human review?

Ask them these four questions: Who reviews the security of the AI-generated code? Who designed the deployment infrastructure? Who responds when something fails at 3 a.m. on a Sunday? Do you know exactly where your data is and who has access? If any answer is “I don’t know” or uncomfortable silence — you have a security problem, not a budget problem.

Does DCM use AI in development?

Yes, every single day. For prototyping, testing, documentation, and refactoring. But every line AI generates passes through human review. Every deployment has a responsible engineer. AI is the force multiplier; the brain behind it is still human.

Immediate action: Search your current repository for these strings: password =, secret =, api_key =. If hardcoded values appear in code (not in environment variables), you have just found your first security gap — and it took less than five minutes.

Need help? → Talk to DCM — we have been building software for more than 12 years that does not crash, does not get hacked, and does not depend on prompts to function.